Sei ragazzi su 10 hanno un’opinione positiva dell’Intelligenza Artificiale, il 31% degli intervistati tra 12 e 18 anni teme il furto d’identità, il 28% è preoccupato per la privacy, il 40% dei ragazzi che usa quotidianamente app come Siri, ChatGpt, Alexa e Google Home non sa che sono basate sull’Intelligenza Artificiale. Questi sono solo alcuni dei dati che emergono dalla ricerca, targata BVA-Doxa e Telefono Azzurro, che ha coinvolto 806 ragazzi tra i 12 e i 18 anni e che è stata presentata all’interno della due giorni a Milano e Roma organizzata dall’associazione in occasione del Safer Internet Day, giornata internazionale sulla sicurezza web istituita nel 2004 dall’Unione Europea.

“Ci arriva anche un bambino”, nome dell’evento, invita a riflettere sul ruolo attivo che hanno i più giovani nell’ecosistema dell’Intelligenza Artificiale (Artificial Intelligence – AI) e pone l’accento sull’urgenza di affrontare le complesse sfide economiche, etiche, di sicurezza e benessere legate al coinvolgimento dei bambini nell’uso della tecnologia.

“Il nostro obiettivo è di contribuire a gettare le basi per azioni ad alto impatto e su più livelli – istituzionale, aziendale ed educativo che tutelino i diritti dei bambini e degli adolescenti in rete.” racconta ad Alley Oop Ernesto Caffo, presidente di Telefono Azzurro. “Crediamo sia responsabilità condivisa quella di proteggere i minori dai rischi del web e delle nuove tecnologie di AI.”

Qual è il rapporto tra ragazzi ed Intelligenza Artificiale?

Al centro della riflessione il rapporto tra i più giovani e l’AI. Dal report BVA-Doxa emerge che il 94% dei giovani ha sentito parlare di Intelligenza Artificiale e ne conosce la definizione, mentre solo il 9% ritiene di possedere una conoscenza molto buona. E se per 6 ragazzi su 10 è positiva l’opinione su questo strumento, tanto da sentirsi pronti a consigliarne l’utilizzo ad amici e parenti (46%), per il 13% dei ragazzi l’intelligenza artificiale è anche utile a distrarsi dai problemi della vita quotidiana e a ricevere supporto nell’affrontare difficoltà emotive e psicologiche.

Scendendo un po’ più in profondità ed entrando nell’ambito di applicazioni come Siri, ChatGPT, Alexa e Google Home, chi afferma di sapere che sono basate sull’Intelligenza Artificiale (il 56%) è di poco superiore a chi non ne è conscio (40%). Questo evidenzia come non ci sia una piena consapevolezza circa i meccanismi e le logiche sottese a strumenti largamente usati nel quotidiano, condizione che può portare ad azioni dalle conseguenze pericolose, non conosciute o sottovalutate. I principali rischi legati all’AI includono preoccupazioni sulla privacy, con bambini e ragazzi che potrebbero non essere coscienti delle informazioni e immagini che condividono online, né dell’uso improprio che se ne potrebbe fare, incappando così in situazioni difficilmente gestibili e che spesso, per vergogna, non vengono condivise con la propria cerchia di affetti, portando così ad una situazione di pericoloso isolamento.

Tutela della privacy e furto d’identità: le preoccupazioni dei più giovani

Se è vero che dalla ricerca emerge un largo uso dell’intelligenza artificiale da parte dei ragazzi che ne apprezzano le potenzialità, è altrettanto vero che ci sono dei timori che minano la loro serenità.

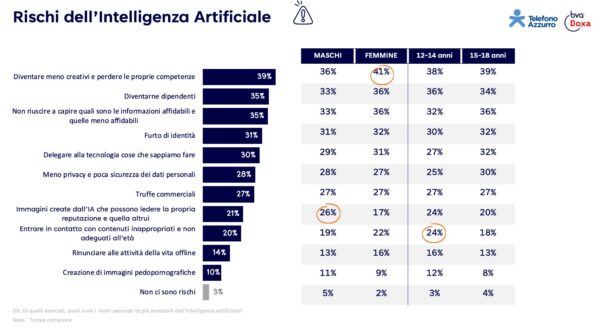

Il 31% degli intervistati vede tra i maggiori rischi dell’AI un possibile furto d’identità, il 28% si preoccupa per la privacy e per la scarsa sicurezza dei propri dati personali. Altri elementi di rischio riguardano la scarsa protezione da situazioni dannose e violente: il timore che le immagini da parte dell’AI possano danneggiare la propria reputazione e quella altrui preoccupa il 21% degli intervistati, mentre il 20% teme di entrare in contatto con contenuti inappropriati e non adeguati alla propria età, con un 10% che esprime la propria preoccupazione per la creazione di immagini pedo-pornografiche.

Preoccupazione, questa, testimoniata anche dai dati diffusi dall’Internet Watch Foundation – IWF che ha dichiarato, in una ricerca di recente pubblicazione, di aver scoperto materiale pedo-pornografico (CSAM – Child Sexual Abuse Material) autogenerato con bambini sotto i 10 anni presente su oltre 100.000 pagine web nell’ultimo anno. Una cifra che rappresenta un aumento del 66% rispetto all’anno precedente. “Tutte le aziende tecnologiche devono fare la loro parte per rendere la rete più sicura adottando misure in grado di proteggere i ragazzi da questo tipo di rischi. La crittografia end-to-end introdotta in molte piattaforme di messaggistica istantanea, aumenta la sicurezza e la privacy di tutti gli utenti, ma accresce il rischio che si utilizzino messaggi criptati per eludere i controlli e diffondere immagini a carattere sessuale di bambini e adolescenti.” – spiega Ernesto Caffo.

AI e diffusione di materiali pedo-pornografici

La generazione di immagini di abusi sessuali a danni di minori tramite Intelligenza Artificiale è un ambito che sta destando preoccupazione. Il report parla complessivamente, di 20.254 immagini generate da intelligenza artificiale pubblicate su un forum dark web dedicato a materiale di abusi su minori in un periodo di un mese: di queste, oltre la metà (11.108 immagini) è stata selezionata per essere valutata dal team di esperti dell’IWF in quanto ritenuta più probabilmente illegale.

L’elemento che desta una forte preoccupazione è che il materiale più convincente generato da intelligenza artificiale è visivamente indistinguibile dal materiale reale, persino per gli analisti addestrati dello stesso Internet Watch Foundation. La condivisione di informazioni personali e il loro uso in svariate modalità, solleva questioni cruciali sulla sicurezza e la gestione responsabile dei dati personali da parte di bambini ed adolescenti, spesso meno consapevoli dei rischi che corrono e quindi più esposti.

Come tutelare i più piccoli?

Il presidente di Telefono Azzurro preme sull’urgente necessità di definire quadri legali ed etici entro cui poter affrontare e contenere gli esiti di processi basati sull’Intelligenza Artificiale. Non mancano esempi internazionali in questa direzione, come ad esempio l’Atto sull’Intelligenza Artificiale dell’Unione Europea che mira a regolare gli utilizzi dell’AI che comportano rischi e danni significativi, al fine di garantire una maggiore trasparenza sull’uso dei dati, o lo Schema degli Stati Uniti per una Carta dei diritti nell’IA, messo a punto sotto forma di piano programmatico con l’obiettivo di proteggere la privacy e i diritti civili delle persone garantendo trasparenza e monitoraggio nel processo di sviluppo degli strumenti di AI. Non ultimo il recente decreto siglato dal presidente degli Stati Uniti, che affronta alcune delle principali minacce di sicurezza legate all’IA.

“Vorrei citare anche il servizio Take It Down offerto gratuitamente dal National Center for Missing and Exploited Children che serve a rimuovere foto e video online di nudo, o contenuti sessualmente espliciti scattati prima dei 18 anni in tutte quelle piattaforme online pubbliche o non criptate che hanno accettato di partecipare.” spiega il presidente di Telefono Azzurro. “È altresì necessario sensibilizzare gli adulti sulla tutela digitale dei figli. Le innovazioni come il riconoscimento biometrico sono ormai di uso comune: al netto dei vantaggi, il loro utilizzo rende più esposti a potenziali furti di dati. Urge quindi trasmettere una maggiore consapevolezza sulle conseguenze legate alla diffusione di informazioni personali in rete e, più in generale, sul tema della privacy.”

Arriva il ChatBot di Telefono Azzurro

Anche Telefono Azzurro si sta muovendo verso un uso più importante dell’Intelligenza Artificiale, al fine di aumentare il grado di efficienza delle proprie linee d’ascolto e di emergenza. Sta infatti analizzando la possibilità di utilizzare le capacità delle tecnologie di Intelligenza Artificiale nei processi delle helpline: il progetto AI ChatBot di Telefono Azzurro si è concentrato sullo sviluppo di un assistente virtuale che – pur non sostituendo mai completamente l’interazione umana – agisce come primo livello di contatto, fornendo informazioni e fungendo da filtro per aiutare gli operatori professionali umani a concentrarsi sui casi più urgenti e ad alta priorità.

“Sicurezza, empatia ed efficacia sono al centro della progettazione e dell’implementazione di un sistema di questo tipo.” – spiega il Presidente di Telefono Azzurro. “In questa prima fase di sviluppo e studio del progetto, l’assistente funziona in ambienti controllati. Quando l’AI ChatBot è attivo, ogni utente che contatta il numero verde 196.96 attraverso il widget di chat online su www.azzurro.it viene informato che sta interagendo con un assistente virtuale. Il sistema è conforme a tutte le leggi sulla privacy e sulla protezione dei dati. L’AI ChatBot vede l’integrazione di un sistema di salvaguardia Human-in-the-Loop (HITL): la costante supervisione umana permette un pronto intervento da parte di operatori professionisti in qualsiasi momento di ogni conversazione grazie a un robusto sistema che riconosce i segnali di rischio e attiva immediatamente l’escalation verso un operatore umano.”

Investire in ricerca ed educazione

Se è vero che risulta imprescindibile intervenire sul piano della sicurezza e del controllo, è altrettanto vero che la ricerca e il tema educativo hanno pari importanza. “In occasione del Safer Internet Day – dice Caffo – abbiamo annunciato la nascita dell’Osservatorio Digital & Kids in collaborazione con il Politecnico di Milano per sviluppare e diffondere conoscenza in merito agli scenari di utilizzo del digitale da parte di bambini e adolescenti cercando di sfruttare il digitale per prevenire e gestire i rischi connessi al web”.

Il mondo dell’Intelligenza Artificiale è in continuo e veloce sviluppo ed innesca sempre nuove sfide in termini di sicurezza e tutela dei più vulnerabili. “Non abbiamo una soluzione ora” afferma il presidente di Telefono Azzurro, ma questa due giorni, così come il continuo lavoro decennale sul campo, vanno nella direzione di tenere alta l’attenzione sul tema, di offrire l’esperienza diretta nella gestione delle criticità ed emergenze manifestate dai bambini e ragazzi di oggi, di connettere gli attori, tutti, che devono prendere delle decisioni concrete per salvaguardare la privacy e la sicurezza dei più piccoli.

***

La newsletter di Alley Oop

Ogni venerdì mattina Alley Oop arriva nella tua casella mail con le novità, le storie e le notizie della settimana. Per iscrivervi cliccate qui.

Per scrivere alla redazione l’indirizzo è: alleyoop@ilsole24ore.com